2024 年 AI 领域的 10 大预测 [译]

预测 #8: Microsoft 与 OpenAI 的合作关系将开始出现裂痕。

1. Nvidia 将尝试推出 GPU 云服务

大多数组织并不是直接向 Nvidia 购买 GPU,而是通过亚马逊云服务(Amazon Web Services)、微软云(Microsoft Azure)和谷歌云平台(Google Cloud Platform)等云服务商来使用 GPU。这些云服务商再从 Nvidia 批量采购芯片。

但亚马逊、微软和谷歌——Nvidia 最大的客户,如今正变成其竞争对手。鉴于当前 AI 领域中大量价值集中在硅芯片上(Nvidia 的股价便是一个明显的证据),这些主要的云服务商都在积极研发自家的 AI 芯片,这将直接与 Nvidia 的 GPU 形成竞争。

云服务商正试图通过深入技术层面,特别是硅芯片领域,来把握更多价值。与此同时,Nvidia 也在朝相反的方向发展,即提供自家的云服务并运营数据中心,这样做旨在减少对传统云公司分销渠道的依赖。

Nvidia 已经开始尝试这一策略,今年早些时候推出了名为 DGX Cloud 的新云服务。我们预测,Nvidia 明年将显著加强这一策略。

这可能包括 Nvidia 自建数据中心(目前 DGX Cloud 还依托于其他云服务商的物理基础设施),甚至可能涉及收购如 CoreWeave 这样的新兴云服务供应商。CoreWeave 与 Nvidia 已有紧密合作,这样的收购可视为 Nvidia 进行垂直整合的一种尝试。总之,随着我们步入 2024 年,预计 Nvidia 与大型云服务商之间的关系将变得更为复杂。

2. Stability AI 离倒闭不远。

在 AI 领域,有一个众所周知的秘密:曾经备受瞩目的创业公司 Stability AI,在 2023 年大部分时间里,就像一列行驶中的慢速列车即将出轨。

Stability 正在经历人才流失。近月来离职的高层包括公司的首席运营官、首席人力资源官、工程副总裁、产品副总裁、应用机器学习副总裁、通讯副总裁、研究主管、音频主管和总法律顾问等。

去年,Coatue 和 Lightspeed 这两家公司领投了 Stability 的 1 亿美元融资轮。但近几个月,由于与 Stability 的 CEO Emad Mostaque 的分歧,这两家公司据说已经先后退出了公司的董事会。今年早些时候,公司曾试图以 40 亿美元的估值筹集更多资金,但最终未能成功。

我们预计,明年这家深陷困境的公司将在不断增长的压力下最终崩溃并关闭。

面对投资者的压力,Stability 已经开始寻找可能的收购者,但到目前为止似乎鲜有企业对此感兴趣。

Stability 最近一个有利的进展是,该公司从 Intel 筹集到 5000 万美元资金,这笔资金将帮助公司延长资金维持期。对 Intel 而言,这项投资显然是出于想要吸引一个重量级客户使用其新推出的 AI 芯片的迫切愿望,因为它正力图在与 Nvidia 的竞争中占据一席之地。

然而,Stability 以其高额的日常开支闻名:在 10 月份 Intel 投资的时候,据报道,Stability 每月的支出高达 800 万美元,而其收入仅占很小一部分。以这种速度消耗资金,5000 万美元的投资恐怕难以撑到 2024 年底。

3. “大语言模型”和“LLM”将逐渐淡出人们的视野。

在当今的 AI 领域,“大语言模型”(及其缩写 LLM)这个词经常被泛指为“任意高级 AI 模型”。这一现象的出现,主要是因为早期如 GPT-3 这样的生成式 AI 模型都是基于文本的。

然而,随着 AI 模型的种类日益增多,AI 技术逐渐向多模态发展,这个术语正变得越来越不准确,也越来越不实用。2023 年,多模态 AI 的兴起已成为 AI 领域的一个标志性主题。如今许多领先的生成式 AI 模型已经涵盖了文本、图像、3D、音频、视频、音乐、甚至是物理动作等更多元素,远不止是传统的语言模型。

比如,有的 AI 模型专门针对蛋白质的氨基酸序列和分子结构进行训练,目的是创造新型蛋白质药物。尽管这类模型在架构上延续了 GPT-3 的设计,但将其简单归类为大语言模型似乎并不恰当。

再看看机器人学中的基础模型,这些大型生成模型结合了视觉和语言输入,并融合了广泛的互联网知识,从而能够在现实世界中实施操作,例如通过机器人手臂。对这类模型而言,“语言模型”显然是个过于狭窄的称呼。研究人员已经开始使用“视觉 - 语言 - 动作”(VLA)模型这样的新术语进行描述。

DeepMind 发布的FunSearch 模型同样是个例子,尽管作者称之为 LLM,但它其实更多地涉及数学问题而非自然语言处理。

到了 2024 年,随着我们的模型变得越来越多维化,描述它们的术语也将随之丰富和多元化。

4. 最先进的商业闭源模型将持续显著领先于最先进的开源模型。

在当下的 AI 领域讨论中,开源与闭源 AI 模型的辩论成为了一个重要话题。尽管像 OpenAI、Google DeepMind、Anthropic 和 Cohere 这样的尖端 AI 模型开发者保留他们最先进模型的专有权,但 Meta 和新兴的初创公司 Mistral 等少数公司选择公开他们的最新模型权重。

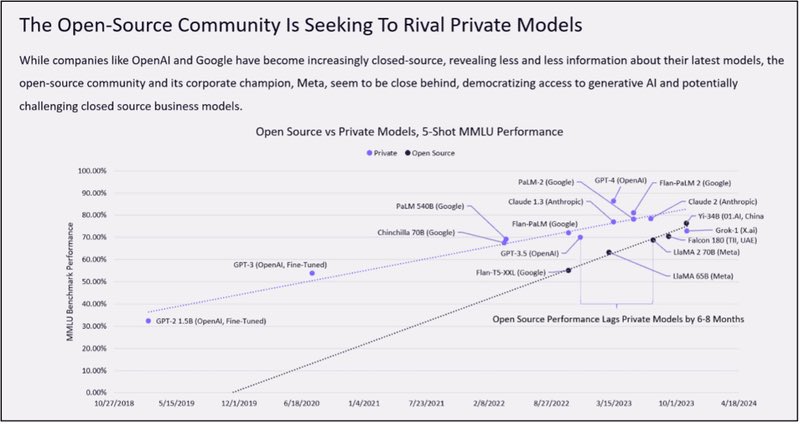

目前,像 OpenAI 的 GPT-4 这样的高性能基础模型仍然是闭源的。然而,许多开源支持者认为封闭和开放模型之间的性能差距正在逐渐缩小,他们甚至预测开放模型很快就会在性能上赶超封闭模型,可能在明年就实现。(最近这张图引发了广泛关注。)

然而,我们对此持有不同看法。我们预测,到 2024 年甚至之后,最顶尖的封闭模型仍将在性能上显著超越最好的开放模型。

在基础模型性能的快速发展领域,Mistral 最近声称,它将在 2024 年某时开源一个与 GPT-4 同等级别的模型,这一声明在开源社区引发了极大热情。但要注意的是,OpenAI 已经在 2023 年初发布了 GPT-4。等到 Mistral 推出这款新模型时,它很可能已经落后于行业发展趋势超过一年。届时,OpenAI 可能已经推出了 GPT-4.5 甚至 GPT-5,从而开启了一个全新的性能时代。(有传闻称 GPT-4.5 甚至可能在 2023 年末之前推出。)

在许多领域,追随先行者并迅速达到行业前沿,相比于最先开创新局面,往往更为容易。比如,OpenAI 在尚未证实可行性的情况下,采用混合专家架构开发 GPT-4,这无疑更具风险、挑战性和成本。而 Mistral 在数月后跟进,使用类似架构开发自己的模型则简单许多。

2024 年,开放模型在性能上超越封闭模型似乎并不容易。推进最先进技术的新模型所需的投资巨大,随着模型能力的提升,所需成本将进一步增加。据估计,OpenAI 开发 GPT-5 的花费约为 20 亿美元。

Meta 作为一家上市公司,必须对股东负责。公司似乎并不指望从其开源模型中直接获利。据悉,Meta 构建 Llama 2 的成本约为 2000 万美元;即便没有直接的收入增加,考虑到战略优势,这样的投资也是合理的。但 Meta 真的会投资近 20 亿美元去开发一个业界领先的 AI 模型,然后无偿开源,不期待任何明确的投资回报吗?

对于像 Mistral 这样的新兴公司而言,这也是一个难题。开源基础模型并没有明确的盈利模式,正如 Stability AI 所经历的那样。例如,提供开源模型的托管服务,最终会陷入激烈的价格竞争,就像我们近日见到的 Mistral 推出的 Mixtral 模型一样。即使 Mistral 拥有数十亿美元用于开发超越 OpenAI 的新模型,它真的会选择无偿分享这一成果吗?

我们有种预感,随着 Mistral 等公司投入更多资金开发更强大的 AI 模型,他们或许会逐渐放弃开源立场,转而将最先进的模型作为专利产品进行收费。

(需要明确的是:这不是反对开源 AI 优点的观点。也不是说开源 AI 在未来人工智能领域不重要。相反,我们认为开源模型在未来几年 AI 的普及中将扮演关键角色。然而,我们预见那些最先进、能推动 AI 极限的系统,将继续保持专有状态。)

5. 许多财富 500 强公司将新设首席人工智能官职位。

今年,人工智能迅速成为财富 500 强公司的首要议题,各行业的董事会和管理团队正忙于弄清楚这一强大新技术对他们的业务意味着什么。

我们预计,明年大型企业普遍采取的策略之一将是任命一位“首席人工智能官”来领导公司的 AI 项目。

十年前,随着云计算的兴起,我们见证了类似的趋势,许多公司开始聘请“首席云计算官”来帮助他们理解云技术的战略意义。

鉴于政府领域正在进行的相似趋势,这一潮流在企业界将获得更大的势头。拜登总统近期的 AI 行政命令要求美国各联邦政府机构任命首席人工智能官,这意味着未来几个月内,美国政府将新增超过 400 名首席 AI 官。

设置首席人工智能官的职位,将成为公司对外展示其对 AI 认真态度的流行方式。但这些角色是否能从长远角度发挥价值,则是另一个值得探讨的问题。(如今还有多少首席云计算官存在?)

6. 替代 Transformer 架构的新兴技术将获得认可并愈发重要。

Transformer 架构最初于 2017 年由 Google 在一篇里程碑式论文中提出,现在已是当今 AI 技术的核心范式。从 ChatGPT、Midjourney 到 GitHub Copilot 等,每一款主流的生成式 AI (Generative AI) 模型和产品都是基于 Transformer 架构构建的。

但技术的主导地位不会永远不变!

在 AI 研究领域的边缘,有些团队正致力于开发全新的、下一代 AI 架构,这些架构在某些方面超越了现有的 Transformer。

其中,Stanford 的 Chris Ré 实验室是这一研究领域的重要中心。Ré 和他的学生致力于研发一种新型模型架构,这种架构在序列长度增加时的计算需求增长率低于二次方(即次二次方的),与现有 Transformer 的二次方增长相比,这样的模型(1)计算需求更低,(2)在处理长序列方面表现更优。Ré 实验室近年推出的一些引人注目的次二次方模型架构包括 S4、Monarch Mixer 和 Hyena。

而最新推出的,也许是最有潜力的次二次方架构是 Mamba。就在上月,Ré 的两位学生发布了 Mamba 研究,这引发了 AI 研究界的极大关注,一些评论员 甚至认为它标志着“Transformer 时代的结束”。

为了寻找 Transformer 架构的替代方案,MIT 开发了液态神经网络,同时由 Transformer 的联合发明者之一领衔的新兴公司 Sakana AI 也在一篇最新报道中被提及。

我们预测,明年将有一种或多种这类新架构实现突破,并开始被广泛采用,它们将从仅仅是新奇的研究领域的产物转变为在实际生产中可靠的 AI 替代方案。

我们并不认为 Transformer 在 2024 年就会退出历史舞台。它们是重要的基础技术,全球最重要的 AI 系统都建立在此基础之上。然而,我们预测,在 2024 年将会有 Transformer 的先进替代品集成到现实世界 AI 应用中。

7. 监管机构将严格审查云服务提供商对 AI 创业公司的战略投资及其带来的会计问题。

今年,从大型科技公司到 AI 创业公司,投资资金如潮水般涌入。

Microsoft 在一月投资了 100 亿美元给 OpenAI,然后在六月又领头对 Inflection 投入了 13 亿美元。随后在秋季,Amazon宣布将对 Anthropic 投资高达 40 亿美元。紧接着,Alphabet 也宣布计划向同一家公司投资高达 20 亿美元。此外,Nvidia 作为今年全球最活跃的 AI 投资者,对包括 Cohere、Inflection、Hugging Face、Mistral、CoreWeave、Inceptive、AI21 Labs 和 Imbue 等多家使用其 GPU 的 AI 创业公司进行了投资。

显而易见,这些投资的部分动机是为了将这些快速增长的 AI 创业公司锁定为长期的计算服务客户。

这类投资触及了会计规则中的一个模糊区域。虽然这听起来像是一个深奥的议题,但它将对 AI 领域的未来竞争格局产生重大影响。

例如,假设某云服务商向一个 AI 创业公司投资 1 亿美元,条件是这家创业公司会用这笔钱来购买其云服务。从本质上看,这对云服务商而言并非真正的独立收入;实际上,该供应商正通过投资将自己资产负债表上的现金转换成收入。

这种被称为“返程投资(round-tripping)”(资金被投出后又迅速回流)的交易模式,今年在硅谷的领导者们中引起了不小的关注,比如风险资本家 Bill Gurley 就对此发表了看法。

正如业内说法所指,“魔鬼常藏于细节之中”。并非所有提及的交易都确实是真正的“返程投资” (round-tripping)。例如,投资是否伴随明确要求初创公司用这些资金购买投资方的产品,或仅仅促进双方的广泛战略合作,这些因素都非常关键。Microsoft 与 OpenAI、Amazon 与 Anthropic 之间的合同并未公开,因此我们无法确切知道它们的结构。

但至少在某些情况下,云服务提供商可能通过这些投资确认了本不该确认的收入。

到目前为止,这些交易几乎没有受到任何监管审查。但这一情况将在 2024 年发生改变。预计明年美国证券交易委员会(SEC)将对 AI 投资中的“返程投资”进行更加严格的审查,并可能导致此类交易的数量和规模大幅下降。

鉴于云服务提供商一直是推动生成式 AI (generative AI) 热潮的主要资本来源,这可能对 2024 年整体 AI 筹资环境产生重大影响。

8. Microsoft/OpenAI 关系将面临挑战。

Microsoft 与 OpenAI 紧密合作。迄今,Microsoft 已向 OpenAI 投入超过 100 亿美元。OpenAI 的模型支持 Microsoft 的关键产品,例如 Bing、GitHub Copilot 和 Office 365 Copilot。上个月,当 OpenAI 的首席执行官 Sam Altman 被董事会意外解雇时,Microsoft 的首席执行官 Satya Nadella 在使他复职中扮演了重要角色。

尽管如此,Microsoft 和 OpenAI 是两个独立的组织,它们有着不同的目标和对 AI 未来的不同远景。虽然迄今这种合作关系对双方都颇有利益,但它更多是一种战略性的结合。这两个组织在许多方面并非完全一致。

我们预测,明年这两个科技巨头之间的合作关系可能会出现问题。实际上,未来可能出现的摩擦迹象已经开始显露。

随着 OpenAI 积极扩展其企业业务,它将日益直接与 Microsoft 在客户争夺战中展开竞争。对 Microsoft 来说,它有着多种理由去寻找除 OpenAI 之外的先进 AI 模型供应商。比如,Microsoft 近期就宣布与 OpenAI 的竞争对手 Cohere 达成合作。面对运营 OpenAI 模型所需的高昂成本,Microsoft 同时也在内部投资小型语言模型的 AI 研究,例如Phi-2。

放眼长远,随着 AI 技术的不断壮大,围绕 AI 安全、风险、监管以及公众问责等方面的问题将成为热点议题。这些问题关系重大。鉴于两家公司不同的文化背景、价值观念和发展历程,它们在处理这些问题的理念和方法上很可能会出现分歧。

作为全球第二大公司,Microsoft 的市值高达 2.7 万亿美元。然而,OpenAI 在 Sam Altman 带领下雄心勃勃目标远大。目前,这两个组织互利共存。但这种状态不太可能永久持续。

9. 2023 年将从人工智能的炒作和跟风现象中回流到加密货币,这一趋势预计将在 2024 年继续。

当前,很难想象风险投资家和科技界领袖会对其他领域比对人工智能更为兴奋。然而一年时间足够发生很多变化,风险投资家们的热情和方向也可能迅速转变。

加密货币行业是一个充满周期波动的领域。虽然目前它的热度有所下降,但我们不应忽视,就像过去在 2013 年、2017 年和 2021 年那样,另一个大的牛市循环是必然会到来的。值得注意的是,比特币的价格自年初的不到 $17,000 起,近几个月已急剧上涨,从 9 月的 $25,000 涨至今日的 $40,000 以上。我们可能正处于一次比特币的重大上涨趋势中,一旦这成为现实,将带动大量的加密货币活动和炒作。

许多如今全情投入于人工智能的知名风险投资家、企业家和技术专家,在 2021-2022 年的加密货币牛市期间曾深度参与加密货币。如果明年加密资产价格强劲回升,可以预见,他们中的一些人将重返加密货币领域,正如他们今年转向人工智能领域一样。

(坦率地说,明年看到过度的人工智能炒作转向其他领域,将是一个值得欢迎的变化。)

10. 至少有一个美国法院将裁决互联网上训练的生成式 AI 模型侵犯了版权。这个问题将逐渐升级到美国最高法院审理。

当今生成式人工智能领域面临一个重大且被低估的法律风险:领先的生成式 AI 模型是基于大量版权内容进行训练的。这一事实可能引发巨大法律责任,甚至改变整个行业的经济模式。

无论是 GPT-4 或 Claude 2 创作的诗歌、DALL-E 3 或 Midjourney 制作的图片,还是 Pika 或 Runway 制作的视频,这些生成式 AI 模型能够制作出惊人的复杂作品,原因在于它们是基于世界上大部分的数字数据训练出来的。通常,AI 公司无偿从互联网上获取这些数据,并自由地用于模型开发。

但是,那些原创这些知识产权的人——书籍的作者、诗人、摄影师、画家、视频制作者——他们是否有权对 AI 从业者如何使用这些作品发表意见呢?他们是否有权分得 AI 模型创造的部分价值呢?

这些问题的答案将取决于法院如何解释一个关键的法律概念——“合理使用”。合理使用是一个历史悠久的法律原则,但在应用于新兴的生成式 AI 领域时,它带来了复杂的理论问题,这些问题尚无明确答案。

“机器学习领域的人可能不太了解合理使用的细节,同时,法院已经裁定一些备受关注的实际案例不适用于合理使用,而这些案例与 AI 输出的作品非常相似,”斯坦福研究员彼得·亨德森指出。“目前,这个领域的诉讼结果还很不确定。”

这些问题将如何解决?答案在于个案审理和法院的裁决。

把合理使用原则应用于生成式 AI 是一项复杂的任务,需要创新思维和主观评判。在这个问题上,双方都有其合理的论据和论点。

因此,不要惊讶明年会有至少一家美国法院裁决,认为像 GPT-4 和 Midjourney 这样的生成式 AI(Generative AI)模型确实违反了版权法,而且开发这些模型的公司需要对模型训练所依赖的知识产权的所有者承担责任。

这并不能解决根本问题。在其他司法区域,面临不同的案件事实,其他美国法院很可能得出完全相反的结论:生成式 AI 模型受到“合理使用”原则的保护。

这个问题将逐渐上升至美国最高法院,最终获得决定性的法律定论。(通往该国最高法院的路径漫长且曲折,不要期待明年就能有最高法院对此问题的裁决。)

在此期间,将会爆发大量诉讼,进行许多和解谈判,世界各地的律师将忙于应对各种案例法的复杂情况。数十亿美元的资金走向将取决于这些诉讼的结果。